Μέγιστη πιθανοφάνεια

Στη στατιστική, η εκτίμηση μέγιστης πιθανοφάνειας (ΕΜΠ) είναι μια μέθοδος για την εκτίμηση των παραμέτρων από ένα στατιστικό μοντέλο δεδομένων.

Η μέθοδος της μέγιστης πιθανοφάνειας αντιστοιχεί σε πολλές γνωστές μεθόδους εκτίμησης της στατιστικής. Για παράδειγμα, μία από αυτές μπορεί να ενδιαφέρεται για τα ύψη των ενήλικων θηλυκών πιγκουίνων, αλλά δεν είναι σε θέση να μετρήσει το ύψος του κάθε πιγκουίνου σε ένα πληθυσμό λόγω των περιορισμών του κόστους ή του χρόνου. Αν υποτεθεί ότι τα ύψη ανήκουν στην Κανονική κατανομή με κάποιο άγνωστο, μέση τιμή και Διακύμανση, η μέση τιμή και η διακύμανση μπορούν να εκτιμηθούν με ΕΜΠ γνωρίζοντας μόνο τα ύψη από κάποιο δείγμα του συνολικού πληθυσμού. Η ΕΜΠ θα το πετύχει αυτό, λαμβάνοντας την μέση τιμή και η διακύμανση ως παραμέτρους και βρίσκοντας ειδικότερες παραμετρικές τιμές που κάνουν τα παρατηρούμενα αποτελέσματα πιο πιθανά δεδομένου του μοντέλου.

Σε γενικές γραμμές, για ένα σταθερό σύνολο των δεδομένων και των υποκείμενων στατιστικών μοντέλων, η μέθοδος της μέγιστης πιθανοφάνειας επιλέγει το σύνολο των τιμών των παραμέτρων του μοντέλου που μεγιστοποιεί την συνάρτηση πιθανότητας. Διαισθητικά, αυτό μεγιστοποιεί την "συμφωνία" από το επιλεγμένο μοντέλο με τα παρατηρούμενα δεδομένα, και για διακριτές τυχαίες μεταβλητές πραγματικά μεγιστοποιεί την πιθανότητα των παρατηρούμενων δεδομένων σύμφωνα με την τελική κατανομή. Η εκτίμηση μέγιστης πιθανοφάνειας δίνει μια ενιαία προσέγγιση για την εκτίμηση, η οποία είναι καλά ορισμένη στην περίπτωση της κανονικής κατανομής και πολλά άλλα προβλήματα.

Ιστορία[Επεξεργασία | επεξεργασία κώδικα]

Η εκτίμηση μέγιστης πιθανοφάνειας είχε προταθεί, αναλυθεί (με άκαρπες προσπάθειες αποδείξεις) και ευρέως διαδωθεί από τον Ρόναλντ Φίσερ μεταξύ 1912 και 1922[1] (αν και είχε χρησιμοποιηθεί νωρίτερα από τους Καρλ Φρίντριχ Γκάους, Πιερ Σιμόν Λαπλάς, Thorvald N Εσένα,Φράνσις Ισίντρο Έτζγουορθ).[2] Περιλήψεις για την ανάπτυξη της μέγιστης πιθανοφάνειας έχουν παρασχεθεί από έναν αριθμό συγγραφέων.[3]

Μερικά τμήματα από τη θεωρία εκτίμηση μέγιστης πιθανοφάνειας αναπτύχθηκαν για Στατιστική Baynes.[1]

Αρχές[Επεξεργασία | επεξεργασία κώδικα]

Ας υποθέσουμε ότι υπάρχει ένα δείγμα x1, x2, ..., xn από n ανεξάρτητες και ταυτόσημα κατανεμημένες παρατηρήσεις, που προέρχονται από μια κατανομή με άγνωστη συνάρτηση πυκνότητας πιθανότητας f0(·). Ωστόσο εικάζεται ότι η συνάρτηση f0 ανήκει σε μια συγκεκριμένη οικογένεια κατανομών { f(·| θ), θ ∈ Θ } (όπου θ είναι φορέας των παραμέτρων για αυτή την οικογένεια), που ονομάζεται παραμετρικό μοντέλο, έτσι ώστε f0 = f(·| θ0). Η τιμή θ0 είναι άγνωστη και αναφέρεται ως η πραγματική τιμή του φορέα της παραμέτρου. Είναι επιθυμητό να βρεθεί ένας εκτιμητής που θα είναι όσο πιο κοντά γίνεται στην πραγματική τιμή θ0. Είτε μία από αυτές είτε και οι δύο οι παρατηρούμενες μεταβλητές xi και η παράμετρος θ μπορεί να είναι φορείς.

Για να χρησιμοποιήσετε τη μέθοδο της μεγίστης πιθανοφάνειας, πρώτα καθορίζεται η από κοινού συνάρτηση πυκνότητας για όλες τις παρατηρήσεις. Για ένα ανεξάρτητο και ισόνομα κατανεμημένο δείγμα, αυτή η κοινή συνάρτηση πυκνότητας είναι

Τώρα κοιτάμε αυτή τη λειτουργία από μια διαφορετική προοπτική, λαμβάνοντας υπόψη τις παρατηρηθείσες τιμές x1, x2, ..., xn να είναι σταθερές "παράμετροι" της λειτουργίας αυτής, όπου θ θα είναι η μεταβλητή της συνάρτησης και μπορεί να κυμαίνεται ελεύθερα· αυτή η λειτουργία θα ονομάζεται η πιθανοφάνεια:

Σημειώστε ότι το " " υποδηλώνει ένα διαχωρισμό μεταξύ των δύο ορισμάτων: και των παρατηρήσεων .

Στην πράξη, είναι συχνά πιο βολικό να συνεργαστεί με το λογάριθμο της συνάρτησης της πιθανοφάνειας, που ονομάζεται λογαριθμική-πιθανοφάνεια:

ή μέση λογαριθμική-πιθανοφάνεια:

Το καπέλο πάνω από το ℓ δείχνει ότι είναι παρόμοιο με κάποιο εκτιμητή. Πράγματι,το αντιπροσωπεύει την αναμενόμενη λογαριθμική-πιθανοφάνεια σε μία μόνο παρατήρηση στο μοντέλο.

Η μέθοδος της μέγιστης πιθανοφάνειας θ0 , εκτιμάται βρίσκοντας μια τιμή του θ που μεγιστοποιεί το . Αυτή η μέθοδος εκτίμησης ορίζει τον εκτιμητή μέγιστης πιθανοφάνειας (ΕΜΠ) του θ0:

αν υπάρχει η μέγιστη. Μια ΕΜΠ εκτίμηση είναι η ίδια, ανεξάρτητα από το αν θα μεγιστοποιήσει την πιθανοφάνεια ή την συνάρτηση της λογαριθμικής πιθανοφάνειας, μιας και ο λογάριθμος είναι μονοτονικά αυξανόμενη συνάρτηση.

Για πολλά μοντέλα, ο εκτιμητής της μέγιστης πιθανοφάνειας μπορεί να βρεθεί ως μια ρητή συνάρτηση με τα δεδομένα παρατηρήσεων x1, ..., xn. Για πολλά άλλα μοντέλα, ωστόσο, καμία κλειστή μορφή λύσης για τη μεγιστοποίηση του προβλήματος είναι γνωστή ή διαθέσιμη, και μια ΕΜΠ πρέπει να βρεθεί αριθμητικά χρησιμοποιώντας βελτιστοποίηση μεθόδων. Για κάποια προβλήματα, μπορεί να υπάρχουν πολλές εκτιμήσεις που μεγιστοποιούν την πιθανοφάνεια. Για άλλα προβλήματα, δεν υπάρχει καμία εκτίμηση μέγιστης πιθανοφάνειας (με την έννοια ότι η συνάρτηση της λογαριθμικής πιθανοφάνειας αυξάνεται χωρίς την χρήση του supremum ).

Στην παραπάνω έκθεση , θεωρείται ότι τα δεδομένα είναι ανεξάρτητα και ισόνομα κατανεμημένα. Η μέθοδος μπορεί να εφαρμοστεί, ωστόσο, σε ένα ευρύτερο πλαίσιο, όσο είναι δυνατόν να γράψετε την από κοινού συνάρτηση πυκνότητας f(x1, ..., xn | θ), και οι παράμετροι θ έχουν πεπερασμένη διάσταση, η οποία δεν εξαρτάται από το μέγεθος του δείγματος n. Σε μια πιο απλή επέκταση, ένα επίδομα μπορεί να γίνει για τα δεδομένα ετερογένεια, ώστε η κοινή πυκνότητα να είναι ίση με f1(x1 | θ) · f2(x2|θ) · ··· · fn(xn | θ). Με άλλα λόγια, υποθέτουμε τώρα ότι κάθε παρατήρηση xi προέρχεται από μια τυχαία μεταβλητή που έχει τη δική της συνάρτηση κατανομής f i . Στην πιο περίπλοκη περίπτωση των μοντέλων χρονοσειρών , η υπόθεση της ανεξαρτησίας μπορεί επίσης να πέσει.

Ένας εκτιμητής μέγιστης πιθανοφάνειας συμπίπτει με τον πιο πιθανό εκτιμητή Bayes έχοντας δοθεί μια συνεχής διανομή των παραμέτρων. Πράγματι, η μέγιστη εκ των υστέρων εκτίμηση της παραμέτρου θ που μεγιστοποιεί την πιθανότητα της θ δοσμένα στοιχεία, που δίνονται από Bayes θεώρημα:

οπού είναι η προηγούμενη διανομή της παραμέτρου θ και είναι η πιθανότητα των δεδομένων κατά μέσο όρο πάνω από όλες τις παραμέτρους. Αφού ο παρονομαστής είναι ανεξάρτητο του θ, ο εκτιμητής Bayes προκύπτει από τη μεγιστοποίηση της όσον αφορά το θ. Αν υποθέσουμε ότι η προηγούμενη είναι μια ομοιόμορφη κατανομή, ο εκτιμητής Bayes προκύπτει από τη μεγιστοποίηση της συνάρτησης πιθανότητας . Έτσι, ο εκτιμητής Bayes συμπίπτει με τον εκτιμητή μέγιστης πιθανοφάνειας για μία προηγούμενη ομοιόμορφη διανομή .

Ιδιότητες[Επεξεργασία | επεξεργασία κώδικα]

Ένας εκτιμητής μέγιστης πιθανοφάνειας είναι ένα extremum εκτιμητής (minimum ή maximum) που λαμβάνεται με την μεγιστοποίηση, ως συνάρτηση του θ, της αντικειμενικής συνάρτησης (c.f., η λειτουργία απώλειας)

αυτό είναι το δείγμα ανάλογο της αναμενόμενης λογαριθμικής-πιθανοφάνειας , όπου αυτή η αναμενόμενη τιμή έχει ληφθεί ως προς την πραγματική πυκνότητα .

Οι εκτιμητές μέγιστης πιθανοφάνειας δεν έχουν βέλτιστες ιδιότητες για πεπερασμένα δείγματα, με την έννοια ότι (όταν αξιολογούνται σε πεπερασμένα δείγματα) άλλοι εκτιμητές μπορεί να έχουν μεγαλύτερη συγκέντρωση γύρω από την πραγματική παραμετρική τιμή.[4] Ωστόσο, όπως και σε άλλες μεθόδους εκτίμησης, η εκτίμηση μέγιστης πιθανοφάνειας διαθέτει μια σειρά από ελκυστικές οριακές ιδιότητες: Καθώς το μέγεθος του δείγματος αυξάνεται στο άπειρο, οι ακολουθίες των εκτιμητών μέγιστης πιθανοφάνειας έχουν αυτές τις ιδιότητες:

- Συνέπεια: η ακολουθία των ΕΜΠ συγκλίνει κατά πιθανότητα στην εκτιμώμενη τιμή .

- Ασυμπτωτική κανονικότητα: καθώς το μέγεθος του δείγματος αυξάνεται, η κατανομή των ΕΜΠ τείνει στην Gaussian κατανομή με μέση και πίνακα συνδιακύμανσης ίσο με το αντίστροφο του πληροφοριακού πίνακα του Φίσερ.

- Αποδοτικότητα, δηλαδή, επιτυγχάνει το Cramér–Rao κάτω φράγμα , όταν το μέγεθος του δείγματος τείνει στο άπειρο. Αυτό σημαίνει ότι κανένας συνεπής εκτιμητής δεν έχει χαμηλότερο ασυμπτωτικό μέσο τετραγωνικό σφάλμα από τον ΕΜΠ (ή άλλων εκτιμητών για την επίτευξη αυτού του φράγματος).

- Δεύτερης-τάξης απόδοτικότητα μετά από διόρθωση για την μεροληψία.

Συνέπεια[Επεξεργασία | επεξεργασία κώδικα]

Υπό τις συνθήκες που περιγράφονται παρακάτω, ο εκτιμητής μέγιστης πιθανοφάνειας είναι συνεπής. Η συνέπεια σημαίνει ότι έχοντας ένα αρκετά μεγάλο αριθμό παρατηρήσεων n, είναι δυνατόν να βρεθεί η τιμή του θ0 με αυθαίρετη ακρίβεια. Σε μαθηματικούς όρους, αυτό σημαίνει ότι καθώς το n τείνει στο άπειρο ο εκτιμητής συγκλίνει κατά πιθανότητα στην πραγματική του τιμή:

Υπό ελαφρώς ισχυρότερες συνθήκες, ο εκτιμητής συγκλίνει σχεδόν βέβαια (ή ισχυρά):

Σε πρακτικές εφαρμογές, τα δεδομένα δεν παράγονται ποτέ από την . Περισσότερο, η είναι ένα μοντέλο, συχνά σε μια ιδεατή μορφή, της διαδικασίας που παράγει τα δεδομένα. Είναι μια κοινή αφοριστική θεώρηση στη στατική σύμφωνα με την οποία όλα τα μοντέλα είναι εσφαλμένα. Έτσι, η πραγματική συνέπεια δεν επιτυγχάνεται στις πρακτικές εφαρμογές. Εντούτοις, η συνέπεια θεωρείται συχνά μια επιθυμητή ιδιότητα για έναν εκτιμητή.

Για να επιτευχθεί συνέπεια, οι ακόλουθες συνθήκες είναι επαρκείς:[5]

- Αναγνωρισιμότητα του μοντέλου:

Με άλλα λογια, διαφορετικές τιμές της παραμέτρου θ αντιστοιχούν σε διαφορετικές κατανομές στα πλαίσια του μοντέλου. Εάν αυτή η συνθήκη δεν ίσχυε, θα υπήρχε μια τιμή θ1 τέτοια ώστε η θ0 και η θ1 θα παρήγαγαν την ίδια κατανομή από τα παρατηρήσιμα δεδομένα. Τότε, δεν θα ήμαστε σε θέση να ξεχωρίσουμε αυτές τις δυο παραμέτρους ακόμα και με άπειρο πλήθος δεδομένων- αυτές οι παράμετροι θα ήταν "ισοδύναμες" ως προς τις παρατηρήσεις (observationally equivalent.)

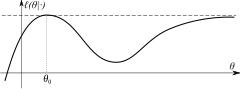

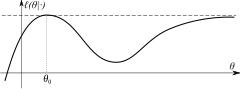

Η συνθήκη αναγνώρισιμότητας είναι απολύτως απαραίτητη για να είναι ένας ΕΜΠ συνεπής. Όταν ισχύει αυτή η συνθήκη, τότε η οριακή συνάρτηση πιθανοφάνειας ℓ(θ|·) έχει μοναδικό ολικό μέγιστο στο θ0.

- Συμπάγεια:ο παραμετρικός χώρος Θ του μοντέλου είναι συμπαγής.

Η συνθήκη αναγνώρισης θεμελιώνει ότι ο λογάριθμος της πιθανοφάνειας έχει μοναδικό ολικό μέγιστο. Η συμπάγεια συνεπάγεται ότι η πιθανοφάνεια δεν μπορεί να προσεγγίσει τη μέγιστη τιμή αυθαίρετα κοντά σε ένα άλλο σημείο (όπως φαίνεται στο παράδειγμα της εικόνας στα δεξιά.

Η συμπάγεια είναι μόνο επαρκής συνθήκη και όχι αναγκαία. Η συμπάγεια δύναται να αντικατασταθεί από άλλες συνθήκες, όπως:

- τόσο η κυρτότητα της συνάρτησης του λογαρίθμου της συνάρτησης πιθανοφάνειας και η συμπάγεια ενός (nonempty) upper level sets του λογαρίθμου της συνάρτησης πιθανοφάνειας, ή

- η ύπαρξη μιας συμπαγούς γειτονιάς N του θ0 τέτοια ώστε έξω από το N η συνάρτηση του λογαρίθμου της συνάρτησης πιθανοφάνειας είναι μικρότερη από το μέγιστο κατά τουλάχιστον κάποιο ε > 0.

- Συνέχεια: η συνάρτηση ln f(x | θ) είναι συνεχής στο is θ για όλες σχεδόν τις τιμές του x:

- Κυριαρχία (Dominance): υπάρχει D(x) ολοκληρώσιμη ως προς την κατανομή f(x | θ0) έτσι ώστε

Η συνθήκη της κυριαρχίας μπορεί να χρησιμοποιηθεί στην περίπτωση των Ανεξάρτητων και ισόνομων παρατηρήσεων. Στην περίπτωση των μη-ισόνομων και ανεξάρτητων τυχαίων μεταβλητών, η ομοιόμορφη σύγκλιση κατά πιθανότητα μπορεί να ελεγχθεί δείχνοντας ότι η ακολουθία είναι is στοχαστικά equicontinuous. Αν κάποιος θέλει να αποδείξει ότι ο ΕΜΠ συγκλίνει στο θ0 σχεδόν βέβαια, τότε μια ισχυρότερη συνθήκη της ομοιόμορφης σχεδόν βέβαιης σύγκλισης πρέπει να επιβληθεί:

Επιπροσθέτως, εαν (όπως έχει υποτεθεί ανωτέρω) τα δεδομένα παραγόντουσαν από την , τότε κάτω από ορισμένες συνθήκες μπορεί να δειχθεί ότι ο ΕΜΠ συγκλίνει κατά νόμο στην κανονική κατανομή. Ειδικότερα,[6]

όπου I είναι ο πίνακας πληροφορίας του Fisher.

Συναρτησιακή ισομεταβλητότητα (Functional equivariance)[Επεξεργασία | επεξεργασία κώδικα]

Ο EMP επιλέγει την τιμή της παραμέτρου η οποία δίνει τα παρατηρούμενα δεδομένα όσο το δυνατόν μεγαλύτερη πιθανότητα (ή πυκνότητα πιθανότητας, στη συνεχή περίπτωση). Αν η παράμετρος αποτελείται από έναν αριθμό στοιχείων, τότε ορίζουμε τους ξεχωριστούς εκτιμητές μέγιστης πιθανοφάνειας, όπως και την αντίστοιχη συνιστώσα του ΕΜΠ της πλήρους παραμέτρου. Σύμφωνα με αυτό, αν είναι ο ΕΜΠ για το θ, και αν g(θ) είναι οποιοσδήποτε μετασχηματισμός της θ, τότε ο ΕΜΠ για α = g(θ) είναι εξ ορισμού

Μεγιστοποιεί το λεγόμενο προφίλ πιθανότητας (profile likelihood):

Οι ΕΜΠ είναι επίσης ισομεταβλητές (equivariant) σε σχέση με ορισμένους μετασχηματισμούς των δεδομένων. Αν Y = g(X), όπου g είναι ένα προς ένα και δεν εξαρτάται από τις παραμέτρους που θα πρέπει να εκτιμηθούν, τότε οι συναρτήσεις πυκνότητας ικανοποιούν την :

και ως εκ τούτου οι συναρτήσεις πιθανοφάνειας για τις X και Y διαφέρουν μόνο κατά ένα συντελεστή που δεν εξαρτάται από τις παραμέτρους του μοντέλου.

Για παράδειγμα, οι ΕΜΠ-παράμετροι της λογαριθμικής-κανονικής κατανομής είναι οι ίδιες με αυτές της κανονικής κατανομής που προσαρμόζεται τον λογάριθμο των δεδομένων.

Αποδοτικότητα[Επεξεργασία | επεξεργασία κώδικα]

Όπως υποτίθεται παραπάνω, εάν τα δεδομένα παραγόντουσαν από την https://wikimedia.org/api/rest_v1/media/math/render/svg/e8c6dbb6ff21ff22012fca066c1115ef63f4a590 τότε υπό ορισμένες προϋποθέσεις, μπορεί ακόμη να δειχθεί ότι ο ΕΜΠ συγκλίνει κατά νόμο στην κανονική κατανομή. Είναι √n-συνεπής και ασυμπτωτικά αποδοτικός, πράγμα που σημαίνει ότι πλησιάζει το όριο Cramér–Rao. Συγκεκριμένα:

όπού I είναι ο πίνακας πληροφορίας του Fisher :

Ειδικότερα, αυτό σημαίνει ότι η μεροληψία του ΕΜΠ είναι ίση με το μηδέν μέχρι και την τάξη n-1/2.

Δεύτερης-τάξης αποδοτικότητα έπειτα από τη διόρθωση της μεροληψίας[Επεξεργασία | επεξεργασία κώδικα]

Ωστόσο, όταν εξετάζουμε υψηλής-τάξης όρους στην επέκταση της κατανοής του εκτιμητή, προκύπτει ότι ο θmle έχει μεροληψία τάξης n-1. Αυτή η μεροληψία ισούται (κατά συνιστώσα) με: [7]

όπου το https://wikimedia.org/api/rest_v1/media/math/render/svg/95ea54922b0b2f15bb16fc33b9545388081c71f7(με άνω δείκτες) δηλώνει την (j,k)-στή συνιστώσα του αντιστρόφου πίνακας πληροφορίας του Fisher, και

Χρησιμοποιώντας αυτούς τους τύπους είναι δυνατόν να εκτιμηθεί η δεύτερης τάξης μεροληψία του ΕΜΠ, και να επιτευχθεί διόρθωση με την αφαίρεση:

Αυτός ο εκτιμητής είναι αμερόληπτος μέχρι τους όρους τάξης n-1, και ονομάζεται ο bias-corrected (ελεύθερος-μεροληψίας;) ΕΜΠ.

Αυτός ο bias-corrected εκτιμητής είναι δεύτερης τάξης αποδοτικός (τουλάχιστον στα πλαίσια της κυρτής εκθετικής οικογένειας), με την έννοια ότι έχει ελάχιστο μέσο τετραγωνικό σφάλμα μεταξύ όλων των δεύτερης τάξης bias-corrected εκτιμητών, μέχρι τους όρους της σειράς n-2. Είναι δυνατόν να συνεχιστεί αυτή η διαδικασία, δηλαδή η εξαγωγή τρίτης τάξης όρων διόρθωσης της μεροληψίας, και ούτω καθεξής. Ωστόσο, όπως φαίνεται από τον Kano (1996), ο εκτιμητής μέγιστης πιθανοφάνειας δεν είναι τρίτης τάξης αποδοτικός.

Σχέση με τη συμπερασματολογία κατά Bayes[Επεξεργασία | επεξεργασία κώδικα]

Ένας ΕΜΠ συμπίπτει με το πιο πιθανό εκτιμητή Bayes δοθείσης ομοιόμορφης εκ των προτέρων κατανομής για τις παραμέτρους. Πράγματι, ο maximum a posteriori estimate είναι η παράμετρος θ που μεγιστοποιεί την πιθανότητα του θ δεσμευμένη στα δεδομένα, βάσει του θεωρήματος Bayes:

όπου είναι η εκ των προτέρων κατανοή για την παράμετρο θ και είναι η πιθανόητητα των δεδομένων κανονικοποιημένη για όλες τις παραμέτρους (averaged over all parameters). Αφού ο παρονομαστής εξαρτάται από το θ, ο εκτιμητής Bayes αποκτάται με τη μεγιστοποίησης της ποσότητας ως προς θ. Εάν υποθέσουμε περαιτέρω ότι η εκ των προτέρων κατανομη είναι η ομοιόμορφη, ο εκτιμητής Bayes αποκτάται με τη μεγιστοποίηση της συνάρτησης πιθανοφάνειας . Έτσι, ο εκτιμητής Bayes συμπίπτει με τον ΕΜΠ για ομοιόμορφη εκ των προτέρων κατανομή .

Εφαρμογή της εκτίμησης μέγιστης πιθανοφάνειας στη θεωρία αποφάσεων Bayes[Επεξεργασία | επεξεργασία κώδικα]

Σε πολλές πρακτικές εφαρμογές στη Μηχανική μάθηση (machine learning), η εκτίμηση μέγιστης πιθανοφάνειας αξιοποιείται για την εκτίμηση παραμέτρων του μοντέλου.

Η θεωρία αποφάσεων Bayes αφορά το σχεδιασμό μιας ταξινόμησης (classifier) που ελαχιστοποιεί τον αναμενόμενο κίνδυνο. Ειδικά, όταν τα κόστη (συνάρτηση απώλειας) που σχετίζονταιι με διαφορετικές αποφάσεις είναι ίσα, η ταξινόμηση είναι η ελαχιστοποίηση του σφάλματος για ολόκληρη την κατανομή.[8]

Έτσι, ο κανόνας απόφασης Bayes διατυπώνεται ως

- "αποφάσισε αν διαφορετικά αποφάσισε "

όπου είναι προβλέψεις για διαφορετικές κλάσεις. Από μια προοπτική ελαχιστοποίησης σφαλμάτων, μπορεί ακόμη να εφραστεί ως

όπου

αν αποφασίσουμε και αν αποφασίσουμε

Εφαρμόζοντας το Θεώρημα Bayes (Bayes' theorem)

- ,

και εάν επιπλέον υποθέσουμε τη συνάρτηση απωλείας zero-or-one, η οποία είναι μια όμοια απώλεια για όλα τα σφάλματα, ο κανόνας απόφασης Bayes Decision δύναται να αναδιατυπωθεί ως

όπου είναι η πρόβλεψη και είναι η εκ των προτέρων πιθανότητα.

Σχέση με την ελαχιστοποίησης της απόκλεισης Kullback–Leibler και την cross εντροπία[Επεξεργασία | επεξεργασία κώδικα]

Η εύρεση ΕΜΠ είναι ασυμπτωτικά ισοδύναμη με την εύρεση του που ορίζει την κατανομή πιθανότητας () που έχει την ελάχιστη απόσταση, στα πλαίσια της απόκλισης Kullback–Leibler (Kullback–Leibler divergence), στην πραγματική κατανομή από την οποία παράγονται τα δεδομένα μας (π.χ., παράγονται από την ).[9] IΣε έναν ιδανικό κόσμο, P και Q είναι ίδιες (και το μόνο άγνωστο είναι το που καθορίζει την P). Ωστόσο, ακόμα και αν δεν είναι ίσες και το μοντέλο που χρησιμοποιούμε είναι εσφαλμένο, ακόμη οι ΕΜΠ θα μας δώσουν την "εγγύτερη" κατανομή (στα πλαίσια των περιορισμών ενός μοντέλου Q που εξαρτάται από το ) στην πραγματική κατανομή .[10]

| Απόδειξη. |

| Για απλοποίηση των συμβολισμών, ας υποθέσουμε ότι P=Q. Έστω n i.i.d δείγματα δεδομένων από κάποια πιθανότητα , που εμείς προσπαθούμε να εκτιμήσουμε βρίσκοντας το που θα μεγιστοποιήσει την πιθανοφάνεια με τη χρήση της , τότε:

όπου . Η χρηση της h μας βοηθά να δούμε πως χρησιμοποιουμε το νόμο των μεγάλων αριθμών (law of large numbers) για να προχωρήσουμε από το μέσου της h(x) στην αναμενόμενη τιμή (expectancy ) του χρησιμοποιώντας τον law of the unconscious statistician. Οι πρώτες (αρκετές- several) μεταβάσεις έχουν να κάνουν με νόμους λογαρίθμων (laws of logarithm) και ότι η εύρεση του που μεγιστοποιεί κάποια συνάρτηση θα είναι επίσης μια που μεγιστοποιεί κάποιο μονότονο μετασχηματισμό εκείνης της συνάρτησης (iπ.χ. προσθέτοντας/πολλάπλασιάζοντας κατά σταθερά). |

Αφού η cross entropy είναι απλά μια Shannon's Entropy συν μια απόκλιση KL και αφού η εντροπία της είναι σταθερή, τότε ο ΕΜΠ ελαχιστοποιεί επίσης την cross entropy ασυμπτωτικά.[11]

Ασυμπτωτική κανονικότητα[Επεξεργασία | επεξεργασία κώδικα]

Σε ένα ευρύ φάσμα καταστάσεων, η παράμετρος του εκτιμητή της μέγιστης πιθανοφάνειας παρουσιάζει ασυμπτωτική κανονικότητα, δηλαδή είναι ίση με την πραγματική παράμετρο συν ένα τυχαίο σφάλμα, το οποίο είναι περίπου κανονικό (δίνονται επαρκή στοιχεία), και η απόκλιση του σφάλματος διασπάται ως 1/n. Για αυτό το ακίνητο σε αναμονή, είναι απαραίτητο ότι ο εκτιμητής δεν υποφέρει από τα ακόλουθα ζητήματα:

Εκτίμηση όριο[Επεξεργασία | επεξεργασία κώδικα]

Μερικές φορές ο εκτιμητής μέγιστης πιθανοφάνειας βρίσκεται στο όριο από το σύνολο των πιθανών παραμέτρων, ή (αν το όριο δεν , για να κυριολεκτήσουμε, επιτρέπεται) η πιθανότητα γίνεται όλο και μεγαλύτερο καθώς η παράμετρος πλησιάζει το όριο. Η κλασσική ασυμπτωτική θεωρία χρειάζεται την υπόθεση ότι η πραγματική τιμή της παραμέτρου βρίσκεται μακριά από το όριο. Αν έχουμε αρκετά δεδομένα, ο εκτιμητής μέγιστης πιθανοφάνειας θα αποκλίνει από το όριο. Αλλά με μικρότερα δείγματα, η εκτίμηση μπορεί να βρίσκετε στο όριο. Σε τέτοιες περιπτώσεις, η ασυμπτωτική θεωρία σαφώς δεν δίνει μια πρακτικά χρήσιμη προσέγγιση. Παραδείγματα εδώ θα είναι διακύμανση-συστατικά μοντέλα, όπου κάθε συστατικό της διακύμανσης, σ2, πρέπει να πληροί τον περιορισμό σ2 ≥ 0.

Τα δεδομένα όρια παράμετρος-εξάρτηση [Επεξεργασία | επεξεργασία κώδικα]

Για να εφαρμοστεί η θεωρία με απλό τρόπο, το σύνολο των δεδομένων αξιών, το οποίο έχει θετική πιθανότητα (ή θετική πιθανότητα πυκνότητας) δεν θα πρέπει να εξαρτάται από την άγνωστη παράμετρος. Ένα απλό παράδειγμα όπου μια τέτοια παράμετρος-εξάρτηση δεν κατέχει είναι η περίπτωση, από την εκτίμηση του θ από ένα σύνολο από ανεξάρτητες και ισόνομα κατανεμημένες όταν η κοινή κατανομή είναι ομοιόμορφη για το εύρος (0,θ). Για εκτιμητικούς σκοπούς, η σχετική σειρά της θ είναι τέτοια που θ δεν μπορεί να είναι μικρότερη από τη μεγαλύτερη παρατήρηση. Επειδή το διάστημα (0,θ) δεν είναι συμπαγές, υπάρχει ανώτατο όριο για την συνάρτηση πιθανοφάνειας: Για κάθε εκτίμηση του θήτα, υπάρχει μια μεγαλύτερη εκτίμηση ότι, επίσης, έχει μεγαλύτερη πιθανότητα. Σε αντίθεση, το διάστημα [0,θ], περιλαμβάνει το τελικό σημείο θ και είναι συμπαγής, στην οποία περίπτωση ο εκτιμητής μέγιστης πιθανοφάνειας υπάρχει. Ωστόσο, στην περίπτωση αυτή, ο εκτιμητής μέγιστης πιθανοφάνειας είναι προκατειλημμένος. Ασυμπτωτικά, αυτός ο εκτιμητής μέγιστης πιθανοφάνειας δεν είναι κανονικά κατανεμημένος.[12]

Ενόχληση παράμετρών[Επεξεργασία | επεξεργασία κώδικα]

Για τον εκτιμητή μέγιστης πιθανοφάνειας, ένα μοντέλο μπορεί να έχει μια σειρά από ενόχληση παραμέτρους. Για την ασυμπτωτική συμπεριφορά που περιγράφεται σε αναμονή, ο αριθμός των ενοχλητικών παραμέτρων δεν θα πρέπει να αυξηθεί με τον αριθμό των παρατηρήσεων (το μέγεθος του δείγματος). Ένα πολύ γνωστό παράδειγμα αυτής της περίπτωσης είναι εκεί όπου οι παρατηρήσεις εμφανίζονται ως ζεύγη, όπου οι παρατηρήσεις σε κάθε ζευγάρι έχουν διαφορετικά (άγνωστα) μέσα, αλλά κατά τα άλλα οι παρατηρήσεις είναι ανεξάρτητες και κανονικά κατανεμημένες με κοινή διακύμανση. Εδώ για 2N παρατηρήσεις, υπάρχουν N + 1 παράμετροι. Είναι γνωστό ότι οι εκτιμητές μέγιστης πιθανοφάνειας της διακύμανσης δεν συγκλίνουν προς την πραγματική τιμή της διακύμανσης.

Περισσότερες πληροφορίες[Επεξεργασία | επεξεργασία κώδικα]

Για τις ασύμπτωτες που κατέχουν σε περιπτώσεις όπου η υπόθεση των ανεξάρτητων και ισόνομα κατανεμημένων παρατηρήσεων δεν κατέχετε, βασική προϋπόθεση είναι ότι η ποσότητα των πληροφοριών των δεδομένων αυξάνει επ ' αόριστον, καθώς το μέγεθος του δείγματος αυξάνει. Μια τέτοια απαίτηση δεν μπορεί να ικανοποιηθεί αν, είτε υπάρχει υπερβολική εξάρτηση των δεδομένων (για παράδειγμα, εάν οι νέες παρατηρήσεις είναι πανομοιότυπες με τις υπάρχουσες παρατηρήσεις), ή εάν οι νέες ανεξάρτητες παρατηρήσεις υπόκεινται σε αύξηση των σφαλμάτων της παρατήρησης.

Κάποιες συνθήκες κανονικότητας που να διασφαλίζουν αυτή η συμπεριφορά είναι:

- Η πρώτη και η δεύτερη παράγωγος της συνάρτησης της λογαριθμικής πιθανοφάνειας πρέπει να οριστεί.

- Ο πίνακας πληροφοριών του Φίσερ δεν πρέπει να είναι μηδέν, και πρέπει να είναι συνεχής, ως παραμετρική συνάρτηση.

- Ο εκτιμητής μέγιστης πιθανοφάνειας να είναι σταθερός.

Ας υποθέσουμε ότι οι συνθήκες για τη συνοχή του εκτιμητή μέγιστης πιθανοφάνειας είναι ικανοποιημένοι, και[13]

- θ0 ∈ εσωτερικό(Θ);

- f(x | θ) > 0 και είναι δύο φορές συνεχώς διαφορίσιμες στο θ σε κάποια γειτονικά Ν του θ0;

- ∫ supθ∈N||∇θf(x | θ)||dx < ∞ και ∫ supθ∈N||∇θθf(x | θ)||dx < ∞;

- I = E[∇θln f(x | θ0) ∇θln f(x | θ0)'] υπάρχει και είναι ομαλό;

- E[supθ∈N||∇θθln f(x | θ)||] < ∞.

Στη συνέχεια, ο εκτιμητής μέγιστης πιθανοφάνειας έχει ασυμπτωτικά κανονική κατανομή:

Απόδειξη, παρακάμπτοντας τις τεχνικές λεπτομέρειες[Επεξεργασία | επεξεργασία κώδικα]

Μιας και η συνάρτηση λογαριθμικής-πιθανοφάνειας είναι διαφορίσιμη, και το βρίσκεται στο εσωτερικό του σύνολου παραμέτρων , για το μέγιστο η πρώτη σείρα όρων που θα πρέπει να πληρούνται είναι:

Όταν η λογαριθμική-πιθανοφάνεια είναι δύο φορές διαφορίσιμη, η έκφραση αυτή μπορεί να επεκταθεί σε σειρά Taylor γύρω από το σημείο :

οπού είναι κάποιο ενδιάμεσο σημείο μεταξύ και . Από αυτή την έκφραση μπορούμε να συνάγουμε ότι

Εδώ η έκφραση στις αγκύλες συγκλίνει με πιθανότητα από το νόμο των μεγάλων αριθμών. Το θεώρημα συνεχούς χαρτογράφησης εξασφαλίζει ότι το αντίστροφο αυτής της έκφρασης, επίσης, συγκλίνει με πιθανότητα, στο . Το δεύτερο άθρισμα, από το κεντρικό οριακό θεώρημα, συγκλίνει στη διανομή σε μια κανονική πολυμεταβλητή με μέση τιμή μηδέν και πίνακα διακύμανσης ίσο με τις πληροφορίες Φίσερ . Έτσι, εφαρμόζοντας το θεώρημα του Slutsky σε όλη την έκφραση, προκύπτει ότι το

Τέλος, η ισότητα πληροφοριών εγγυάται ότι όταν το μοντέλο είναι σωστά καθορισμένο, ο πίνακας θα είναι ίσος με τον πίνακα πληροφοριών του Φίσερ , έτσι ώστε η διακύμανση απλοποιείτε απλά στην έκφραση .

Παραδείγματα[Επεξεργασία | επεξεργασία κώδικα]

Διακριτή ομοιόμορφη κατανομή[Επεξεργασία | επεξεργασία κώδικα]

Σκεφτείτε την περίπτωση όπου n εισιτήρια αριθμημένα από το 1 έως το n , τοποθετούνται σε ένα κουτί και επιλέγεται ένα τυχαία (βλ ομοιόμορφη κατανομή)· έτσι, το μέγεθος του δείγματος είναι 1. Αν n είναι άγνωστο, τότε ο εκτιμητής μέγιστης πιθανοφάνειας του n είναι ο αριθμός m για το επιλεχθέν εισιτήριο. (Η πιθανοφάνεια είναι 0 για n < m, 1/n για n ≥ m, και αυτή είναι μεγαλύτερη όταν n = m. Σημειώστε ότι ο εκτιμητής μέγιστης πιθανοφάνειας του n παρουσιάζεται στα κάτω άκρα των πιθανών τιμών {m, m + 1, ...}, και όχι κάπου στη "μέση" του εύρους των πιθανών τιμών, η οποία θα οδηγήσει σε λιγότερο σφάλμα.) Η αναμενόμενη τιμή του αριθμού m για το επιλεχθέν εισιτήριο, και ως εκ τούτου, η αναμενόμενη τιμή του , είναι (n + 1)/2. Ως αποτέλεσμα, με ένα δείγμα μεγέθους 1, η μέγιστη πιθανότητα εκτιμητής για το n συστηματικά υποτιμούν n (n − 1)/2.

Διακριτή κατανομή, πεπερασμένο παράμετρος χώρο[Επεξεργασία | επεξεργασία κώδικα]

Ας υποθέσουμε ότι κάποιος επιθυμεί να καθορίσει το σφάλμα ενός άδικου νομίσματος . Ονομάζουμε την πιθανότητα να τύχει ΚΟΡΌΝΑ p. Ο στόχος, στη συνέχεια, γίνεται για να προσδιορίσετε το p.

Ας υποθέσουμε ότι ρίξαμε το νόμισμα 80 φορές: δηλαδή, το δείγμα μπορεί να είναι κάτι σαν x1 = H, x2 = T, ..., x80 = T, και η καταμέτρηση του αριθμού των ΚΟΡΟΝΏΝ "H" που παρατηρείται.

Η πιθανότητα να ρίξει ΓΡΆΜΜΑΤΑ είναι 1 − p (εδώ, λοιπόν, p είναι θ ανωτέρω). Ας υποθέσουμε ότι το αποτέλεσμα είναι 49 ΚΟΡΌΝΕΣ και τις 31 ΓΡΆΜΜΑΤΑ, και ας υποθέσουμε ότι το νόμισμα επιλέχτηκε από ένα κουτί που περιέχει τρία νομίσματα: ένα που δίνει ΚΟΡΌΝΑ με πιθανότητα p = 1/3, το οποίο δίνει ΚΟΡΌΝΑ με πιθανότητα p = 1/2 και ένα άλλο που δίνει ΚΟΡΌΝΑ με πιθανότητα p = 2/3. Τα νομίσματα έχουν χάσει τις ετικέτες τους, οπότε δεν γνωρίζουμε ποιο είναι ποιο. Χρησιμοποιώντας τον εκτιμητή μέγιστης πιθανοφάνειας το νόμισμα που έχει τη μεγαλύτερη πιθανοφάνεια μπορεί να βρεθεί, με τα δεδομένα που παρατηρήθηκαν. Χρησιμοποιώντας την συνάρτηση μάζας πιθανότητας της διωνυμικής κατανομής με μέγεθος δείγματος ίσο με το 80,ο αριθμός των επιτυχιών είναι ίσος με 49 αλλά για διαφορετικές τιμές του p (η "πιθανότητα επιτυχίας"), η συνάρτηση πιθανοφάνειας (που ορίζεται παρακάτω), λαμβάνει μία από τις τρεις τιμές:

Η πιθανοφάνεια μεγιστοποιείται όταν p = 2/3, οπότε αυτός είναι ο εκτιμητής μέγιστης πιθανοφάνειας για το.

Διακριτή κατανομή, η συνεχής παράμετρος χώρο[Επεξεργασία | επεξεργασία κώδικα]

Τώρα, ας υποθέσουμε ότι υπήρχε μόνο ένα νόμισμα, αλλά η p θα μπορούσε να έχει οποιαδήποτε τιμή 0 ≤ p ≤ 1. Η συνάρτηση πιθανοφάνειας για να μεγιστοποιηθεί είναι

και η μεγιστοποίηση είναι πάνω από όλες τις δυνατές τιμές 0 ≤ p ≤ 1.

Ένας τρόπος για να μεγιστοποιηθεί η συνάρτηση αυτή είναι με διαφοροποίηση όσον αφορά το p και ρύθμιση στο μηδέν:

η οποία έχει λύσεις, p = 0, p = 1 και p = 49/80. Η λύση που μεγιστοποιεί την πιθανότητα να είναι σαφώς p = 49/80 (αφού p = 0 και p = 1 το αποτέλεσμα στην πιθανοφάνεια του μηδέν). Έτσι, ο εκτιμητής μέγιστης πιθανοφάνειας για το p είναι 49/80.

Το αποτέλεσμα αυτό είναι εύκολα γενικευμένη αντικαθιστώντας ένα γράμμα όπως το t στη θέση 49 για να αντιπροσωπεύει τον παρατηρούμενο αριθμό των "επιτυχιών" της δοκιμής Bernoulli μας, και ένα γράμμα όπως n στη θέση 80, για να αντιπροσωπεύει τον αριθμό των δοκιμών Bernoulli. Ακριβώς το ίδιο για τον υπολογισμό των αποδόσεων, ο εκτιμητής μέγιστης πιθανοφάνειας t / n για κάθε ακολουθία n δοκιμών Bernoulli με αποτέλεσμα t 'επιτυχίες'.

Συνεχής κατανομή, η συνεχής παράμετρος χώρο[Επεξεργασία | επεξεργασία κώδικα]

Για την κανονική κατανομή που έχει συνάρτηση πυκνότητας πιθανότητας

η αντίστοιχη συνάρτηση πυκνότητας πιθανότητας για ένα δείγμα από n ανεξάρτητες και ισόνομα κατανεμημένες κανονικές τυχαίες μεταβλητές (η πιθανότητα) είναι

ή πιο σωστά:

όπου είναι η μέση τιμή του δείγματος.

Αυτή η οικογένεια των κατανομών έχει δύο παραμέτρους: θ = (μ, σ), οπότε μπορούμε να μεγιστοποιήσουμε την πιθανοφάνεια, , πάνω από δύο παραμέτρους ταυτόχρονα, ή, αν είναι δυνατόν, ξεχωριστά.

Δεδομένου ότι ο λογάριθμος είναι μια συνεχής αυστηρά αυξανόμενη λειτουργία πάνω από το φάσμα της πιθανοφάνειας, οι τιμές που μεγιστοποιούν την πιθανοφάνεια, θα μεγιστοποιήσουν επίσης και τον λογάριθμό του. Αυτή η λογαριθμική πιθανοφάνεια μπορεί να γραφτεί ως εξής:

(Σημείωση: η λογαριθμική-πιθανοφάνεια είναι στενά συνδεδεμένη με τις πληροφορίες εντροπία και τις πληροφορίες Φίσερ.)

Μπορούμε τώρα να υπολογίσουμε τις παραγώγους αυτής της λογαριθμικής-πιθανοφάνειας ως εξής.

Αυτό λύνεται με

Αυτό είναι πράγματι το μέγιστο της συνάρτησης, δεδομένου ότι είναι το μόνο σημείο καμπής στο μ και η δεύτερη παράγωγος είναι αυστηρά μικρότερη από το μηδέν. Η αναμενόμενη τιμή είναι ίση με την παράμετρο μ της συγκεκριμένης διανομής,

που σημαίνει ότι ο εκτιμητής μέγιστης πιθανοφάνειας είναι αμερόληπτος.

Ομοίως μπορούμε να διαφορίσουμε την λογαριθμική πιθανοφάνεια ως προς το σ και είναι ίσο με το μηδέν:

το οποίο λύνεται με

Εισαγωγή της εκτίμησης θα αποκτηθεί από

Για να υπολογίσουμε την αναμενόμενη τιμή της, είναι βολικό να ξαναγράψουμε την έκφραση σε σχέση με μηδέν-μέσες τυχαίες μεταβλητές (στατιστικό σφάλμα) . Εκφράζοντας την εκτίμηση σε αυτές τις μεταβλητές αποδόσεις

Απλοποιόντας την έκφραση παραπάνω, αξιοποιώντας τα γεγονότα ότι και μας επιτρέπει να αποκτήσουμε

Αυτό σημαίνει ότι ο εκτιμητής είναι εσφαλμένος. Ωστόσο, είναι σταθερή.

Επίσημα μπορούμε να πούμε ότι ο εκτιμητής μέγιστης πιθανοφάνειας για το είναι:

Στην περίπτωση αυτή, οι ΕΜΠ θα μπορούσε να επιτευχθεί ξεχωριστά. Σε γενικές γραμμές, αυτό μπορεί να μην είναι η περίπτωση, και οι ΕΜΠ θα πρέπει να λαμβάνονται ταυτόχρονα.

Η κανονική λογαριθμική πιθανοφάνεια στο μέγιστο παίρνει μια ιδιαίτερα απλή μορφή:

Αυτή η μέγιστη λογαριθμική πιθανοφάνεια μπορεί να αποδειχθεί ότι είναι το ίδιο για πιο γενικότερων ελαχίστων τετραγώνων, ακόμα και για μη-γραμμικά ελάχιστα τετράγωνα. Αυτό συχνά χρησιμοποιείται για τον προσδιορισμό της πιθανοφάνειας με βάση την προσέγγιση του διαστήματος εμπιστοσύνης και τις περιοχές εμπιστοσύνης, οι οποίες είναι γενικά πιο ακριβή από ότι εκείνες που χρησιμοποιούν την ασυμπτωτική κανονικότητα που συζητήθηκε παραπάνω.

Μη-ανεξάρτητες μεταβλητές[Επεξεργασία | επεξεργασία κώδικα]

Μπορεί να είναι η υπόθεση ότι οι μεταβλητές συσχετίζονται, δηλαδή, δεν είναι ανεξάρτητες. Δύο τυχαίες μεταβλητές X και Y είναι ανεξάρτητες μόνο αν η από κοινού συνάρτηση πυκνότητας πιθανότητας είναι το γινόμενο των επιμέρους συναρτήσεων πυκνότητας πιθανότητας, δηλ.

Ας υποθέσουμε ότι κάποιος κατασκευάζει μια σειρά-n Gauss διανυσμάτων από τυχαίες μεταβλητές , όπου κάθε μεταβλητή έχει μέσο που δίνεται από . Επιπλέον, ας έχουμε τον πίνακα συνδιακύμανσης ότι θα συμβολίζεται με .

Η κοινή συνάρτηση πυκνότητας πιθανότητας αυτών των n τυχαίων μεταβλητών, στη συνέχεια, δίνεται από:

Σε αυτό και σε άλλες περιπτώσεις όπου η κοινή συνάρτηση πυκνότητας υπάρχει η συνάρτηση πιθανοφάνειας ορίζεται όπως παραπάνω, στην ενότητα Αρχές, χρησιμοποιώντας αυτή την πυκνότητα.

Επαναληπτικές διαδικασίες[Επεξεργασία | επεξεργασία κώδικα]

Σκεφτείτε τα προβλήματα που και τα δύο μέλη και οι παράμετροι όπως το απαιτούν να εκτιμηθούν. Επαναληπτικές διαδικασίες όπως αλγόριθμοι Προσδοκίας-μεγιστοποίησης μπορούν να χρησιμοποιηθούν για την επίλυση κοινού κατάσταση-εκτίμηση παραμέτρων προβλημάτων.

Για παράδειγμα, ας υποθέσουμε ότι n δείγματα μιας κατάστασης εκτιμούν , μαζί με μια μέση τιμή δείγματος έχουν υπολογιστεί είτε από μια ελάχιστη διακύμανση Kalman φίλτρο ή μια ελάχιστη διακύμανση ομαλότερη χρησιμοποιώντας μια προηγούμενη εκτίμηση διακύμανσης . Στη συνέχεια η ημερήσια διακύμανση επαναλαμβάνω μπορεί να ληφθεί από τον υπολογισμό του εκτιμητή μέγιστης πιθανοφάνειας

Η σύγκλιση των ΕΜΠ εντός φιλτραρίσματος και η εξομάλυνση των αλγόριθμοι Προσδοκίας (ΑΠ) έχει μελετηθεί στην βιβλιογραφία.[14][15][16]

Εφαρμογές[Επεξεργασία | επεξεργασία κώδικα]

Η εκτίμηση μέγιστης πιθανοφάνειας χρησιμοποιείται για ένα ευρύ φάσμα των στατιστικών μοντέλων, συμπεριλαμβανομένων:

- γραμμικών μοντέλων και γενικευμένων γραμμικών μοντελών

- διερευνητική και επιβεβαιωτική παραγοντική ανάλυση

- δομικά μοντέλα εξισώσεων

- πολλές καταστάσεις στο πλαίσιο των έλεγχων υποθέσεων και διαστημάτων εμπιστοσύνης

- διακριτή επιλογή μοντέλων

- ανίχνευση σήματος (φιλτράρισμα).

Οι χρήσεις αυτές προκύπτουν σε εφαρμογές σε ευρύ σύνολο από τομείς, συμπεριλαμβανομένων:

- συστήματα επικοινωνίας;

- ψυχομετρική;

- οικονομετρία;

- χρονική καθυστέρηση άφιξης (ΧΚΑ) σε ακουστική ή ηλεκτρομαγνητική ανίχνευση

- μοντελοποίηση δεδομένων στην πυρηνική και σωματιδιακή φυσική;

- μαγνητική τομογραφία;[17][18]

- υπολογιστική φυλογενετική;

- προέλευση/προορισμό και τη διαδρομή-επιλογή μοντέλων σε δίκτυα μεταφορών

- γεωγραφική δορυφορική-εικονική ταξινόμηση

- το ηλεκτρικό σύστημα κατάστασης εκτίμησης.

Δείτε επίσης[Επεξεργασία | επεξεργασία κώδικα]

- Άλλες μέθοδοι εκτίμησης

- Γενικευμένη μέθοδος των ροπών είναι μέθοδοι που σχετίζονται με την πιθανότητα εξίσωση στην εκτίμηση μέγιστης πιθανοφάνειας.

- M-εκτιμητής, μια προσέγγιση που χρησιμοποιείται σε ισχυρά στατιστικά στοιχεία.

- Μέγιστη εκ των υστέρων (MAP) εκτιμητής, για μια αντίθεση με τον τρόπο για τον υπολογισμό εκτιμητών όταν η προγενέστερη γνώση είναι αξιωματική.

- Μέγιστη εκτίμηση απόστασης, η σχετική μέθοδος αυτή είναι πιο ισχυρή σε πολλές περιπτώσεις.

- Μέθοδος των ροπών (στατιστικά στοιχεία), μια άλλη δημοφιλής μέθοδος για την εύρεση των παραμέτρων των κατανομών.

- Μέθοδος στήριξης, μια παραλλαγή της μέγιστης πιθανότητας τεχνική.

- Εκτίμηση ελάχιστης απόστασης

- Εκτιμητής Κουάσι-μέγιστης πιθανοφάνειας, ένας ΕΜΠ εκτιμητής που είναι μη εξειδικευμένος, αλλά εξακολουθεί να είναι σταθερός.

- Περιορισμένη μέγιστη πιθανοφάνεια, μια παραλλαγή χρησιμοποιώντας μια συνάρτηση πιθανότητας που υπολογίζεται από ένα μετασχηματισμένο σύνολο δεδομένων.

- Σχετικές έννοιες:

- Το BHHH αλγόριθμος είναι μια μη-γραμμική βελτιστοποίηση του αλγορίθμου που είναι δημοφιλής για εκτιμήσεις Μέγιστης Πιθανοφάνειας .

- Extremum εκτιμητής, μια πιο γενική κλάση των εκτιμητών που ο ΕΜΠ ανήκει.

- Φίσερ, πληροφορίες,πίνακας πληροφοριών για τη σχέση του με τον πίνακα συνδιακύμανσης ML εκτιμήσεων

- Λειτουργεία Πιθανοφάνειας, μια περιγραφή σχετικά με το τι συναρτήσεις πιθανότητας υπάρχουν.

- Μέσου τετραγωνικού σφάλματος, ένα μέτρο του πόσο "καλός" ειναι ενας εκτιμητής της κατανομής της παραμέτρου (είναι ο εκτιμητής μέγιστης πιθανοφάνειας ή κάποιος άλλος εκτιμητής).

- RANSAC, μια μέθοδος για τον υπολογισμό των παραμέτρων του μαθηματικού μοντέλου δεδομένων που περιέχει ακραίες τιμές

- Το Rao–Blackwell θεώρημα, ένα αποτέλεσμα, το οποίο παράγει μια διαδικασία για την εύρεση του καλύτερου δυνατού αμερόληπτου εκτιμητή (με την έννοια της έχοντας ελάχιστη μέσου τετραγωνικού σφάλματος). Το ΕΜΠ είναι συχνά ένα καλό σημείο εκκίνησης για τη διαδικασία.

- Επαρκής στατιστική, η συνάρτηση των δεδομένων, μέσω των οποίων το ΕΜΠ (αν υπάρχει και είναι μοναδικό) θα εξαρτηθεί από τα δεδομένα.

Παραπομπές[Επεξεργασία | επεξεργασία κώδικα]

- ↑ 1,0 1,1 Pfanzagl, Johann, with the assistance of R. Hamböker (1994). Parametric statistical theory. Walter de Gruyter, Berlin, DE. σελίδες 207–208. ISBN 3-11-013863-8.

- ↑ Edgeworth & September 1908) and Edgeworth & December 1908)

- ↑ Savage (1976), Pratt (1976), Stigler (1978, 1986, 1999), Hald (1998, 1999), and Aldrich (1997)

- ↑ Pfanzagl (1994, p. 206)

- ↑ Newey & McFadden (1994, Theorem 2.5.)

- ↑ By Theorem 3.3 in Newey, Whitney K.· McFadden, Daniel (1994). «Chapter 36: Large sample estimation and hypothesis testing». Στο: Engle, Robert· McFadden, Dan. Handbook of Econometrics, Vol.4. Elsevier Science. σελίδες 2111–2245. ISBN 978-0-444-88766-5.

- ↑ Cox & Snell (1968, formula (20))

- ↑ Christensen, Henrikt I. «Pattern Recognition» (PDF) (lecture). Bayesian Decision Theory - CS 7616. Georgia Tech.

- ↑ cmplx96 (https://stats.stackexchange.com/users/177679/cmplx96), Kullback–Leibler divergence, URL (version: 2017-11-18): https://stats.stackexchange.com/q/314472 (at the youtube video, look at minutes 13 to 25)

- ↑ Introduction to Statistical Inference | Stanford (Lecture 16 — MLE under model misspecification)

- ↑ Sycorax says Reinstate Monica (https://stats.stackexchange.com/users/22311/sycorax-says-reinstate-monica), the relationship between maximizing the likelihood and minimizing the cross-entropy, URL (version: 2019-11-06): https://stats.stackexchange.com/q/364237

- ↑ Lehmann & Casella (1998)

- ↑ Newey & McFadden (1994, Theorem 3.3.)

- ↑ Einicke, G.A.; Malos, J.T.; Reid, D.C.; Hainsworth, D.W. (January 2009). «Riccati Equation and EM Algorithm Convergence for Inertial Navigation Alignment». IEEE Trans. Signal Processing 57 (1): 370–375. doi:

- ↑ Einicke, G.A.; Falco, G.; Malos, J.T. (May 2010). «EM Algorithm State Matrix Estimation for Navigation». IEEE Signal Processing Letters 17 (5): 437–440. doi:

- ↑ Einicke, G.A.; Falco, G.; Dunn, M.T.; Reid, D.C. (May 2012). «Iterative Smoother-Based Variance Estimation». IEEE Signal Processing Letters 19 (5): 275–278. doi:

- ↑ Sijbers, Jan; den Dekker, A.J. (2004). «Maximum Likelihood estimation of signal amplitude and noise variance from MR data». Magnetic Resonance in Medicine 51 (3): 586–594. doi:. PMID 15004801.

- ↑ Sijbers, Jan; den Dekker, A.J.; Scheunders, P.; Van Dyck, D. (1998). «Maximum Likelihood estimation of Rician distribution parameters». IEEE Transactions on Medical Imaging 17 (3): 357–361. doi:. PMID 9735899.

Περαιτέρω ανάγνωση[Επεξεργασία | επεξεργασία κώδικα]

Εξωτερικοί σύνδεσμοι[Επεξεργασία | επεξεργασία κώδικα]

- Hazewinkel, Michiel, επιμ.. (2001), «Maximum-likelihood method», Encyclopedia of Mathematics, Springer, ISBN 978-1-55608-010-4, http://www.encyclopediaofmath.org/index.php?title=p/m063100

- Μέγιστη Πιθανότητα Εκτίμηση Αστάρι (ένα εξαιρετικό σεμινάριο)

- Εφαρμογή MLE για τη δική σας πιθανότητα λειτουργία χρησιμοποιώντας το R

- Μια επιλογή πιθανότητα συναρτήσεις στο R

- «Tutorial on maximum likelihood estimation». Journal of Mathematical Psychology. CiteSeerX: 10.1.1.74.671.

![{\displaystyle \ell (\theta )=\operatorname {E} [\,\ln f(x_{i}\mid \theta )\,]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/89299c0b338b214fa61aba7fb8148da496d20c74)

![{\displaystyle \operatorname {\mathbb {P} } {\Bigl [}\;\ln f(x\mid \theta )\;\in \;C^{0}(\Theta )\;{\Bigr ]}=1.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d3d9110b4a94639d23daa24b3cac7449a67ace0e)

![{\displaystyle I_{jk}=\operatorname {E} _{X}{\bigg [}\;{-{\frac {\partial ^{2}\ln f_{\theta _{0}}(X_{t})}{\partial \theta _{j}\,\partial \theta _{k}}}}\;{\bigg ]}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/803f853cf894a2a57aeac142fa1e92b68fb9ced6)

![{\displaystyle b_{s}\equiv \operatorname {E} [({\hat {\theta }}_{\mathrm {mle} }-\theta _{0})_{s}]={\frac {1}{n}}\cdot I^{si}I^{jk}{\big (}{\tfrac {1}{2}}K_{ijk}+J_{j,ik}{\big )}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c8852849e7365631959a01287a5a8689649e87f6)

![{\displaystyle {\tfrac {1}{2}}K_{ijk}+J_{j,ik}=\operatorname {E} _{X}{\bigg [}\;{\frac {1}{2}}{\frac {\partial ^{3}\ln f_{\theta _{0}}(X_{t})}{\partial \theta _{i}\,\partial \theta _{j}\,\partial \theta _{k}}}+{\frac {\partial \ln f_{\theta _{0}}(X_{t})}{\partial \theta _{j}}}{\frac {\partial ^{2}\ln f_{\theta _{0}}(X_{t})}{\partial \theta _{i}\,\partial \theta _{k}}}\;{\bigg ]}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/69f1519de79d19d9127b82da1d8cb8ebb0315bcf)

![{\displaystyle h_{\text{Bayes}}={\underset {w}{\operatorname {arg\;max} }}\,{\bigl [}\,\operatorname {\mathbb {P} } (x\mid w)\,\operatorname {\mathbb {P} } (w)\,{\bigr ]}\;,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8946d22343b827b9f92e1bdd602bb4f99c8f379)

![{\displaystyle {\begin{aligned}{\hat {\theta }}&={\underset {\theta }{\operatorname {arg\,max} }}\,L_{P_{\theta }}(\mathbf {y} )={\underset {\theta }{\operatorname {arg\,max} }}\,P_{\theta }(\mathbf {y} )={\underset {\theta }{\operatorname {arg\,max} }}\,P(\mathbf {y} \mid \theta )\\&={\underset {\theta }{\operatorname {arg\,max} }}\,\prod _{i=1}^{n}P(y_{i}\mid \theta )={\underset {\theta }{\operatorname {arg\,max} }}\,\sum _{i=1}^{n}\log P(y_{i}\mid \theta )\\&={\underset {\theta }{\operatorname {arg\,max} }}\,\left(\sum _{i=1}^{n}\log P(y_{i}\mid \theta )-\sum _{i=1}^{n}\log P(y_{i}\mid \theta _{0})\right)={\underset {\theta }{\operatorname {arg\,max} }}\,\sum _{i=1}^{n}\left(\log P(y_{i}\mid \theta )-\log P(y_{i}\mid \theta _{0})\right)\\&={\underset {\theta }{\operatorname {arg\,max} }}\,\sum _{i=1}^{n}\log {\frac {P(y_{i}\mid \theta )}{P(y_{i}\mid \theta _{0})}}={\underset {\theta }{\operatorname {arg\,min} }}\,\sum _{i=1}^{n}\log {\frac {P(y_{i}\mid \theta _{0})}{P(y_{i}\mid \theta )}}={\underset {\theta }{\operatorname {arg\,min} }}\,{\frac {1}{n}}\sum _{i=1}^{n}\log {\frac {P(y_{i}\mid \theta _{0})}{P(y_{i}\mid \theta )}}\\&={\underset {\theta }{\operatorname {arg\,min} }}\,{\frac {1}{n}}\sum _{i=1}^{n}h_{\theta }(y_{i})\quad {\underset {n\to \infty }{\longrightarrow }}\quad {\underset {\theta }{\operatorname {arg\,min} }}\,E[h_{\theta }(y)]\\&={\underset {\theta }{\operatorname {arg\,min} }}\,\int P_{\theta _{0}}(y)h_{\theta }(y)dy={\underset {\theta }{\operatorname {arg\,min} }}\,\int P_{\theta _{0}}(y)\log {\frac {P(y\mid \theta _{0})}{P(y\mid \theta )}}dy\\&={\underset {\theta }{\operatorname {arg\,min} }}\,D_{\text{KL}}(P_{\theta _{0}}\parallel P_{\theta })\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c2c8b560e4cc7f5d9d1584e7361c86fb7db2f2b)

![{\displaystyle 0={\frac {1}{n}}\sum _{i=1}^{n}\nabla _{\!\theta }\ln f(x_{i}\mid \theta _{0})+{\Bigg [}\,{\frac {1}{n}}\sum _{i=1}^{n}\nabla _{\!\theta \theta }\ln f(x_{i}\mid {\tilde {\theta }})\,{\Bigg ]}({\hat {\theta }}-\theta _{0}),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5170e44678c5b72443b5685bd87971786c00ba1a)

![{\displaystyle {\sqrt {n}}({\hat {\theta }}-\theta _{0})={\Bigg [}\,{-{\frac {1}{n}}\sum _{i=1}^{n}\nabla _{\!\theta \theta }\ln f(x_{i}\mid {\tilde {\theta }})}\,{\Bigg ]}^{-1}{\frac {1}{\sqrt {n}}}\sum _{i=1}^{n}\nabla _{\!\theta }\ln f(x_{i}\mid \theta _{0})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2c02cdd981e5b00ef4c695d531e9e59c31dd3bf1)

![{\displaystyle H=\mathbb {E} \left[-\nabla _{\theta \theta }\ln f(x|\theta _{0})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4b104a558dd3e091f968fd4dc0c503a2caebdeae)

![{\displaystyle {\begin{aligned}\Pr(\mathrm {H} =49\mid p=1/3)&={\binom {80}{49}}(1/3)^{49}(1-1/3)^{31}\approx 0.000,\\[6pt]\Pr(\mathrm {H} =49\mid p=1/2)&={\binom {80}{49}}(1/2)^{49}(1-1/2)^{31}\approx 0.012,\\[6pt]\Pr(\mathrm {H} =49\mid p=2/3)&={\binom {80}{49}}(2/3)^{49}(1-2/3)^{31}\approx 0.054.\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/36bc1e5127816685c557ccd68d4f4081d0b7f9fa)

![{\displaystyle {\begin{aligned}{0}&{}={\frac {\partial }{\partial p}}\left({\binom {80}{49}}p^{49}(1-p)^{31}\right)\\[8pt]&{}=49p^{48}(1-p)^{31}-31p^{49}(1-p)^{30}\\[8pt]&{}=p^{48}(1-p)^{30}\left[49(1-p)-31p\right]\\[8pt]&{}=p^{48}(1-p)^{30}\left[49-80p\right]\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/59361405e649a8d9c8c489d2580f5c86cfda7e75)

![{\displaystyle E\left[{\widehat {\mu }}\right]=\mu ,\,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/03999a84fea80614645116bb85fbf613fc01aee7)

![{\displaystyle {\begin{aligned}0&={\frac {\partial }{\partial \sigma }}\log \left(\left({\frac {1}{2\pi \sigma ^{2}}}\right)^{n/2}\exp \left(-{\frac {\sum _{i=1}^{n}(x_{i}-{\bar {x}})^{2}+n({\bar {x}}-\mu )^{2}}{2\sigma ^{2}}}\right)\right)\\[6pt]&={\frac {\partial }{\partial \sigma }}\left({\frac {n}{2}}\log \left({\frac {1}{2\pi \sigma ^{2}}}\right)-{\frac {\sum _{i=1}^{n}(x_{i}-{\bar {x}})^{2}+n({\bar {x}}-\mu )^{2}}{2\sigma ^{2}}}\right)\\[6pt]&=-{\frac {n}{\sigma }}+{\frac {\sum _{i=1}^{n}(x_{i}-{\bar {x}})^{2}+n({\bar {x}}-\mu )^{2}}{\sigma ^{3}}}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/68d0241d927c952be882b0bed12f5893c02e37ed)

![{\displaystyle E\left[\delta _{i}\right]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b2906900d8bc1aecb95c71d171f887f279c8af1a)

![{\displaystyle E[\delta _{i}^{2}]=\sigma ^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd7cf47ddab79ccd3c57bf03ecd7561079a1907a)

![{\displaystyle E\left[{\widehat {\sigma }}^{2}\right]={\frac {n-1}{n}}\sigma ^{2}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dfadc13a6c658c9f6a9f9f89b8ff6093f48456fc)

![{\displaystyle f(x_{1},\ldots ,x_{n})={\frac {1}{(2\pi )^{n/2}{\sqrt {{\text{det}}(\Sigma )}}}}\exp \left(-{\frac {1}{2}}\left[x_{1}-\mu _{1},\ldots ,x_{n}-\mu _{n}\right]\Sigma ^{-1}\left[x_{1}-\mu _{1},\ldots ,x_{n}-\mu _{n}\right]^{T}\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f9cc29097b417e3acd0430d10983ecb072660250)

![{\displaystyle f(x,y)={\frac {1}{2\pi \sigma _{x}\sigma _{y}{\sqrt {1-\rho ^{2}}}}}\exp \left[-{\frac {1}{2(1-\rho ^{2})}}\left({\frac {(x-\mu _{x})^{2}}{\sigma _{x}^{2}}}-{\frac {2\rho (x-\mu _{x})(y-\mu _{y})}{\sigma _{x}\sigma _{y}}}+{\frac {(y-\mu _{y})^{2}}{\sigma _{y}^{2}}}\right)\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d2cc6f2e4f872519b8de5b2f42db03cd866bc430)